요약문

2022년 이후 본격 상용화된 생성형 인공지능은 언론과 방송의 제작, 편집, 배포 전 과정을 근본적으로 재편할 잠재력을 보여주고 있다. 이러한 기술적 변화는 공영미디어에 새로운 기회를 제공하는 동시에 중대한 도전도 제기한다. 공영미디어는 급변하는 시청자 행동과 치열한 글로벌 미디어 시장의 경쟁 압력 속에서 보편적 서비스를 유지하기 위해 AI 활용 전략을 적극적으로 모색해야 한다. 본 글은 영국 BBC, 일본 NHK, 유럽 공영미디어 연합체 EBU가 AI를 혁신적 도구로 도입해 이러한 구조적 변화에 어떻게 대응하고 있는지를 살펴보고, 국내 공영미디어가 향후 AI로 열어야 하는 혁신 방향과 전략적 선택에 적용할 수 있는 사례들을 검토하고자 한다.

1. 들어가며

21세기 디지털 전환의 핵심 동력 중 하나는 인공지능(AI)이며, 방송·영상 산업도 예외가 아니다. 특히 공영미디어(PSM: Public Service Media)는 공적 가치(public value)와 기술 혁신이라는 이중적 책무를 동시에 지니고 있어, AI 도입은 단순한 효율화 차원을 넘어 공공성과 윤리성을 전제한 새로운 창작 패러다임을 요구한다. 공영미디어는 2022년 챗GPT의 등장 이후 생성형 AI(Generative AI)를 활용해 시청자에게 더 나은 서비스를 제공하고, 공적 재원의 가치를 높이는 방안을 적극적으로 모색하고 있다. AI는 직원들의 업무 효율을 높이고, 시청자 서비스의 범위를 확장하며, 디지털 경험을 개선하는 데 기여할 수 있다는 점에서 다양한 실험과 시도가 이어지고 있다.

공영미디어가 AI를 활용하는 주요 영역은 자동화(automation), 개인화(personalization), 신뢰성 관리(verification)로 정리할 수 있다. 자동화는 음성 인식, 자동 자막, 요약 등 반복적 노동을 AI가 대체함으로써 업무 효율을 높이는 분야이다. 개인화는 추천 시스템과 맞춤형 콘텐츠 제공을 통해 시청자 경험을 향상시키는 영역이며, 신뢰성 관리는 저널리즘 강화를 위해 팩트체킹, 오류 탐지, 출처 검증 등에 AI를 적용하는 분야이다. 다만 각 공영미디어는 처한 환경과 전략적 우선순위가 다르기 때문에 활용 방식에도 차이가 존재한다. 이에 따라 BBC, NHK, 유럽방송연맹(EBU)의 AI 활용 사례를 통해 공영미디어가 어떠한 혁신을 추진하고 있는지를 살펴보고자 한다.

2. BBC, AI 활용의 두 갈래 길

BBC는 생성형 AI가 확산하기 훨씬 이전인 2010년대 중반부터 BBC R&D를 중심으로 AI와 기계학습(ML) 기술을 미디어 제작에 적용하기 위한 다양한 시도를 이어왔다.1) 당시의 시도들은 주로 프로토타입 수준에 머물렀으며, 라이브 이벤트 중계 규모를 확대하거나 방대한 아카이브를 효율적으로 검색하기 위한 자동 메타데이터 생성 등에 초점이 맞추어졌다. 그러나 챗GPT의 등장 이후 BBC의 AI 활용은 두 갈래로 뚜렷하게 나뉘었다. 하나는 뉴스를 중심으로 진행된 12개의 파일럿 프로젝트이며, 다른 하나는 상업 자회사인 BBC 스튜디오(Studios)가 글로벌 콘텐츠 제작의 혁신을 목표로 설립한 AI 크리에이티브 랩(Creative Lab)이다.

2-1. BBC, 뉴스를 중심으로 한 12개 파일럿 프로젝트

BBC는 생성형 AI가 빠르게 확산함에 따라 공공 이익 중심, 인재와 창의성 우선, 투명성 유지를 핵심 원칙으로 설정하고 이를 공개했다.2) 이후 BBC는 12개의 생성형 AI(Generative AI) 파일럿 프로젝트를 발족했으며, 이들 프로젝트는 콘텐츠 가치 극대화, 새로운 시청자 경험 제공, 효율적 업무 처리를 목표로 하고 있다. 프로젝트들은 먼저 내부에서 비공개로 테스트한 뒤 단계적으로 공개되는 방식으로 진행되고 있다. 3)

현재 외부에 알려진 11개의 프로젝트는 크게 세 가지 방향으로 나눌 수 있다. 첫째, 콘텐츠 가치의 극대화를 위한 프로젝트로 다국어 변환과 콘텐츠 재포맷팅이 있다. 예를 들어 BBC 월드서비스는 국제적으로 높은 신뢰도를 가진 BBC 뉴스 기사를 여러 언어로 변환하여 도달 범위를 확대하고, 기사의 가치를 극대화하기 위해 사내 AI 도구인 프랭크(Frank)를 활용해 번역 초고를 작성하고 있다.

접근성과 속도의 제고를 위한 프로젝트도 추진 중이다. 라디오 스포츠 생중계 해설을 AI가 자동으로 텍스트 기반 스포츠 중계 페이지로 전환하거나, 오디오 업데이트를 신속히 제공해 사용자 접근성을 강화하는 방식이다.

특히 BBC 사운드의 《마이 클럽 데일리(My Club Daily)》 파일럿은 새 축구 시즌 개막 후 4주간 진행되었다. 이 프로젝트는 리버풀, 애스턴 빌라, 뉴캐슬 유나이티드, 사우샘프턴, 플리머스 아가일 등 다섯 개 잉글랜드 클럽의 팬들을 대상으로, 정기적으로 맞춤형 오디오 게시판을 제공했다. 선정된 다섯 팀은 전국 여러 지역과 부서에 걸쳐 파일럿이 얼마나 효과적으로 작동하는지를 검증하기 위한 사례로 선택되었다.

운영 과정은 다음과 같다. 각 클럽과 관련된 기존 BBC 기사를 선별하고, 이를 재구성하여 오디오 스크립트 초안을 제작한다. 이후 챗GPT로 초안 스크립트를 생성하고, 일레븐랩스(ElevenLabs)를 활용해 합성 음성을 입힌다. 이렇게 제작된 오디오는 편집팀이 정확성을 검증하고 AI 사용 사실을 명시한 뒤, 매일 오후 5시에 BBC Sounds에 게시된다.

전통적인 방식으로 클럽별 맞춤형 오디오 게시판을 제작하려면 큰 비용이 소요된다. 이에 BBC는 기자들이 생산한 기존 정보를 AI로 재활용해 TV, 라디오, 온라인 서비스 전반에서 효율적으로 제공할 수 있는지를 모색하고 있다. 동시에 기존 콘텐츠의 재포맷을 통해 더 많은 이용자가 손쉽게 콘텐츠를 즐길 수 있는지, 그 효과와 확장성을 파일럿 프로젝트로 검증하고 있다.

둘째, 새로운 시청자 경험 구축을 목표로 한 파일럿 프로젝트에는 BBC 바이트사이즈(BBC Bitesize)의 대화형 챗봇과 개인화 마케팅이 있다. BBC 바이트사이즈 어시스턴트(BBC Bitesize Assistant)는 BBC의 교육 플랫폼인 바이트사이즈(Bitesize)에 도입된 AI 기반 챗봇으로, 학생들에게 개인화된 학습 경로를 제공하고 질문에 실시간으로 응답하는 학습 비서 역할을 수행한다. 2024년 2월부터 개발을 시작했으며, 단순한 디지털 교재를 넘어 AI 기반 개인화 학습 플랫폼으로 전환함으로써 새로운 학습 경험을 제공하는 것을 목표로 한다.

BBC의 개인화 마케팅 프로젝트는 상업적 수익을 목적으로 하는 개인화와는 다른 접근을 취한다. BBC R&D와 서리대학교가 공동으로 수행하는 AI4ME 프로젝트는 BBC의 콘텐츠 특성과 시청자 맥락에 따라 어떤 형태의 개인화가 효과적인지를 탐색하며, 이를 기반으로 새로운 추천 시스템과 맞춤형 서비스 방안을 모색하고 있다.

셋째, 업무의 신속성과 효율성 개선을 위한 파일럿 프로젝트에는 저널리스트 지원, 콘텐츠 라벨링, AI 생성 자막 및 대본 등이 포함된다. 저널리스트 지원 부문에서는 2024년부터 내부 테스트가 진행 중이다. ‘헤드라인 지원기(headline helper)’와 ‘뉴스 요약(news article summarization)’ 도구가 그 사례이다. 헤드라인 지원기는 기자가 AI를 통해 여러 개의 헤드라인 옵션을 제시받고, 최종 선택은 기자 개인과 편집 부서의 검토를 거쳐 이뤄진다. 성과 검증은 독자의 실제 행동을 반영한 ‘클릭률 A/B 테스트(click-through uplift A/B)’와 AI가 제공하는 선택지의 다양성을 평가하는 헤드라인 분산(headline variance) 지표를 활용해 이뤄지고 있다.

콘텐츠 라벨링 프로젝트는 BBC 아카이브와 뉴스 부문이 주도한다. 뉴스 기사, 방송 프로그램, 아카이브 영상 등 대규모 콘텐츠에 대해 주제, 키워드, 장르, 인물, 장소 등 메타데이터를 자동 생성·라벨링 하여 검색성(discoverability)을 높이고, 특정 순간의 영상 클립이나 모음집과 같은 새로운 형태의 콘텐츠 제작을 지원한다. 또한 기자나 제작자의 수동 태깅 부담을 줄여 업무 효율을 높이고, 콘텐츠 재활용 및 개인화 추천 시스템 구축을 위한 기반을 마련하는 것을 목표로 하고 있다.

콘텐츠 라벨링은 출처와 인증을 강화하여 투명성을 확보하는 방향으로도 발전하고 있다. BBC 뉴스 검증팀(News Verify)은 마이크로소프트, 어도비, 인텔 등과 함께 C2PA(Coalition for Content Provenance and Authenticity)의 창립 회원사로 참여하고 있다. 이를 통해 기자가 취득한 뉴스 사진이나 영상에 출처, 편집 내역, AI 생성 여부 등을 디지털 서명 방식으로 기록하고, 인증 메타데이터(C2PA metadata)를 부착해 BBC 플랫폼에 배포함으로써 뉴스의 진본성과 투명성을 제고하고 있다.

AI 생성 자막 및 대본 파일럿은 BBC 사운드에서 2024년 8월부터 3개월간 평가판으로 운영되었다. BBC 사운드는 매월 약 27,000시간 분량의 콘텐츠를 제작하지만, 영국 내 약 1,800만 명에 이르는 청각장애인·청력 손실자·이명 환자에게는 접근성이 제한적이었다. 이를 개선하기 위해 BBC는 오디오 콘텐츠에 자막을 제공하는 방안을 모색해 왔으나, 수동 자막화는 시간과 비용 부담이 크다. 이에 따라 AI가 고품질·고정확도의 자막을 자동으로 생성할 수 있는지를 검증하는 파일럿을 진행하였다. 위스퍼 AI(Whisper AI)라는 음성-텍스트 변환 도구를 활용해 대본을 신속히 생성한 뒤, 편집팀이 이를 검토·수정하여 최종 대본을 오디오와 함께 BBC 사운드에 업로드하는 방식으로 운영되었다.

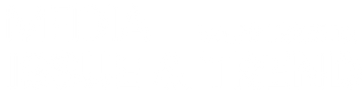

한편, BBC는 실제 뉴스 제작 과정에도 생성형 AI 도구를 점진적으로 도입하고 있다. 대표적인 사례로는 2025년 6월 공개된 '한눈에 보기(At a glance)' 요약 도구와 'BBC 스타일 어시스트(BBC Style Assist)'가 있다.4)

'한눈에 보기' 요약 도구는 길고 복잡한 기사의 핵심 내용을 간략한 문단으로 제공하는 서비스다. 특히 젊은 독자층을 대상으로 하며, 기자들이 사내 AI 모델에 승인된 프롬프트(prompt)를 입력하면 3~5개의 핵심 문장으로 요약된 결과가 생성된다. 이후 기자가 이를 수정·검토한 뒤 발행하며, AI 활용 여부는 명확히 표시된다.

‘BBC 스타일 어시스트’는 BBC의 지역 파트너 기자들이 송고한 기사를 BBC 온라인 뉴스 스타일에 맞게 각색·재구성하는 것을 지원하기 위해 개발되었다. BBC는 2017년부터 ‘지역 민주주의 리포팅 서비스’(LDRS: Local Democracy Reporting Service)라는 이름으로 지역 독립 뉴스 매체와 공공서비스 뉴스 파트너십을 운영하고 있으며, LDRS에서 생산된 기사는 BBC를 포함한 1,000여 개 참여 뉴스 기관에 무료로 제공된다. 현재 약 160명의 LDRS 파트너 기자가 매일 수백 건의 기사를 송고하지만, 이를 BBC 뉴스 스타일로 재가공하는 데 상당한 시간이 소요되었다.

BBC 스타일 어시스트는 BBC R&D가 개발한 자체 훈련 기반 대규모 언어모델(LLM)을 활용해 LDRS 기사를 BBC의 스타일과 톤에 맞는 초안으로 변환한다. 이후 BBC 책임 기자가 내용을 검토하여 정확성과 명확성을 확보한 뒤 승인하면, BBC 뉴스 웹사이트와 앱에 게재된다. 특히 기자의 사전 검토 없이는 어떠한 내용도 게시되지 않으며, AI 도구는 원본 기사 작성에는 관여하지 않는다. 현재 1단계 파일럿은 BBC 웨일스와 잉글랜드 동부 지역 뉴스팀에서 진행 중이며, 기자들은 도구의 기능을 시험하고 피드백을 제공하며 성능 개선에 기여하고 있다. 앞서 살펴본 11개 파일럿 프로젝트(비공개 1개 제외)의 주요 내용은 <표 1>에 요약되어 있다.

| 파일럿 | 조직/팀 | 목표 | 활용 | 출시상태 |

|---|---|---|---|---|

| 다국어 변환 | BBC World Service & 뉴스 | 뉴스를 여러 언어로 변환 | 콘텐츠 가치 극대화: 도달율 확대 | 2024년 이후 내부 시험 |

| 스포츠 라이브 멀티모달 | BBC 스포츠/사운드 | 중계 오디오를 텍스트 전환/클럽별 업데이트 | 속도: 접근성 | 2024년 이후 내부 시험 |

| 학습 챗봇 | BBC Bitesize | 개인화 학습 보조 챗봇 | 새로운 청중 경험; 교육 | 내부/제한적 |

| 개인화 마케팅 | BBC 마케팅 | 메시지·크리에이티브 개인화 | 도달율 확대; 개인화 | 2024년 이후 내부 시험 |

| 헤드라인 헬퍼 | BBC 뉴스 | 여러 제목 후보를 기자에게 제안 | 효율성 아이데이션 | 2024년 이후 내부 시험 |

| 뉴스 기사 요약 초안 | BBC 뉴스 | 내부용 빠른 요약 초안 | 효율성; 워크플로우 | 내부 |

| 콘텐츠 라벨링/메타데이터 | BBC 아카이브/뉴스 | 자동 라벨링 지원으로 검색·재활용성 향상 | 아카이브 재활용: 검색성 | 2024년 이후 내부 시험 |

| 진본성 라벨링 (C2PA) | BBC News Verify | 콘텐츠에 출처 라벨 부착 | 투명성 신뢰 | 상시 진행 |

| 자막 및 대본 생성 | BBC Sound | 청각장애 및 약자를 위한 자막생성 | 효율성, 도달율 확대 | 2024년 이후 내부시험 |

| 한눈에 보기 (뉴스 요약) | BBC 뉴스 (Growth, Innovation & AI) | 긴 기사 핵심을 글머리표 요약으로 제공, 특히 젊은 독자층 |

청중 경험; 접근성 | 2025년 6월 공개 시범 |

| BBC 스타일 어시스트 (LDRS 카피 편집) |

BBC 뉴스 / LDRS (웨일스·동부 잉글랜드) |

지역 뉴스 원고를 BBC 하우스 스타일로 빠르게 변환 |

효율성; 일관성; 워크플로우 | 2025년 6월 공개 시범 |

BBC는 2025년 3월 <BBC News Growth, Innovation & AI>라는 새로운 부서를 신설했으며,5) 7월 28일 블룸버그 미디어와 메타(Meta) 아시아태평양 지역 미디어 파트너십 디렉터를 지낸 안잘리 카푸르(Anjali Kapoor)를 부서 책임자로 임명했다.6) 이 조직은 뉴스룸 전반에 AI를 적용하여 콘텐츠 제작과 배포 방식을 혁신하고, 특히 25세 이하 시청자를 겨냥한 실험적 콘텐츠 전략을 총괄한다. 이는 플랫폼별로, 분절적으로 운영되던 기존 체계에서 벗어나 모든 플랫폼을 아우르는 일관된 편집·배포 구조를 구축하려는 시도로 평가할 수 있다.

2-2. BBC 스튜디오: 콘텐츠 제작의 혁신을 위한 AI 크리에이티브 랩

제작 측면에서 BBC는 상업 자회사인 BBC 스튜디오를 통해 AI 활용을 적극적으로 시도하고 있다. BBC 스튜디오는 2025년 7월 24일, AI를 활용한 창의적 스토리텔링, 제작 워크플로 개선, 새로운 장르 탐색을 위한 허브로 AI 크리에이티브 랩(AI Creative Lab)의 출범을 발표했다.7) 이 허브는 각본·비각본·오디오·어린이 프로그램 등 전 장르에 걸쳐 혁신을 추진하는 것을 목표로 한다. 현재 BBC 스튜디오는 기술 중심의 접근보다는 창의성과 기술의 융합(interdisciplinary convergence)을 강조하며, AI 크리에이터, 기술 전문가, 프로듀서 등 전문 인력을 채용하고 있다.(Franks, 2025)

BBC 제작 부문은 이미 다큐멘터리 인터뷰, 자연사 방송, 교육 콘텐츠 등에서 AI와 인접 기술을 시범적으로 적용해 왔다. 2022년 방영된 다큐멘터리 《I'm An Alcoholic: Inside Recovery》에서는 익명성이 보장되어야 하는 알코올중독자 자조모임 AA( Alcoholics Anonymous) 참여자를 보호하기 위해 기존의 모자이크·블러 처리 대신 AI 기반 얼굴 바꾸기(face swap) 기법을 활용했다.8) 이를 통해 익명성을 유지하면서도 시청자에게 감정 전달의 몰입감을 효과적으로 구현할 수 있었다. 동시에 시청자 혼선을 방지하기 위해 음성과 자막을 통해 해당 장면이 "디지털로 변경된 얼굴"임을 명확히 고지했다.

자연사 다큐멘터리 《Springwatch》에서는 컴퓨터 비전과 딥러닝 모델을 이용해 야생동물의 출현을 자동으로 식별했다.9) 예컨대 특정 조류의 울음소리를 수천 시간의 오디오 파일에서 자동 탐지하고, 그 결과를 생태 연구 및 편집에 활용했다. 이를 통해 AI가 공영미디어의 과학·교육 콘텐츠에 기여할 수 있음을 입증했다. 이후 《Blue Planet II》와 《Prehistoric Planet》 제작 과정에서도 첨단 CGI와 AI 보조기술을 접목해 시각적 리얼리즘을 극대화했다.

또한 BBC Maestro는 2025년 《AI 애거사 크리스티(Agatha Christie)》 강의를 공개했다. 이 프로젝트는 애거사 크리스티의 음성과 영상을 디지털로 복원해 마치 그녀가 직접 창작법 강의를 진행하는 듯한 경험을 제공한 사례다. 저작권자, 가족, 학자들이 제작 과정에 참여했으며 윤리적·법적 검증 절차도 수반되었다. 이 강의는 교육 콘텐츠의 새로운 차원을 개척한 사례로 평가받고 있다.(Savage, 2025) BBC Maestro는 BBC Studios Distribution Ltd의 라이선스를 받아 Maestro Media Ltd가 개발·운영하는 상업 플랫폼이다.

AI 크리에이티브 랩은 BBC 스튜디오의 대표작인 블루이(Bluey), 해피 밸리(Happy Valley), 블루 플래닛 II(Blue Planet II) 등의 제작 전문성에 AI를 접목해 제작 효율성과 혁신을 확대하려 한다. 이를 위해 메타데이터 태깅, 스토리보드 생성과 같은 작업을 자동화하고, 《Springwatch》에서의 머신러닝 기반 야생동물 감지 사례처럼 시각효과, 자동 편집, 자산 관리 기능을 고도화하고 있다. 이러한 AI 실험은 내부 혁신에 그치지 않고, 레이블 및 외부 파트너와의 협업을 통해 글로벌 시장에도 파급효과를 미치려는 의도를 갖고 있다. 또한 BBC Maestro의 AI 기반 애거사 크리스티 강의와 같은 파일럿 프로그램을 토대로 향후 콘셉트 아이디어 구상, 대본 분석, 제작 워크플로 전반에서 AI를 적용하는 실험을 확대할 계획이다. 무엇보다 AI 크리에이티브 랩의 시도는 공영미디어가 단순히 시장 경쟁을 위해 기술을 도입하는 것이 아니라, 공적 책무를 기반으로 한 혁신을 추진한다는 점에서 의의가 크다.

AI는 단순한 노동 대체 도구가 아니라 새로운 서사 구조·형식·미학을 탐색하는 창작 파트너로 기능할 수 있다. 창작자와 AI의 협업 모델은 창의성 이론에서 말하는 공동 창조(co-creation) 개념과 부합하며, 이는 방송 제작 과정의 인적·기술적 하이브리드 생태계를 가속한다는 시사점을 제공한다.

그러나 AI 크리에이티브 랩의 실험은 불가피하게 몇 가지 윤리적 긴장을 수반한다. 첫째, 저작권과 저자성(authorship) 문제는 AI 기반 창작물에서 핵심 갈등 요소다. 둘째, 노동시장 재편과 창작자 권리 보호 문제가 부각될 수 있다. 셋째, AI가 생성한 콘텐츠의 오류나 편향에 대한 책임성(accountability) 문제 역시 주요 논란이 될 수 있다. BBC가 AI 원칙을 강조하는 것은 이러한 윤리적 위험을 제도적 장치로 관리하려는 시도로 이해할 수 있다.

- 1) BBC (2017. 01. 01). AI in media production. BBC Media Centre.

BBC. What we're doing with AI.BBC Media Centre. - 2) BBC. (2023, October 11). Our approach to generative AI. BBC Media Centre.

- 3) Davies, R. T. (2024. 02. 28). An update on the BBC's plans for Generative AI (Gen AI) and how we plan to use AI tools responsibly.

- 4) Davies, R. T. (2025. 06. 27). BBC to launch new Generative AI pilots to support news production.

- 5) Savage, M. (2025. 03. 06). BBC News to create AI department to offer more personalised content. The Guardian.

- 6) Considine, P. (2025. 07. 28). BBC News appoints director AI, Innovation & Growth. Televisual.

- 7) Daswani, M. (2025. 07. 24). BBC Studios Productions Launches AI Creative Lab. Worldscreen.

- 8) BBC (2024.03.). How the BBC used face swapping to anonymize interviewees. BBC R&D.

- 9) Dawes. R.(2023. 01. 27). Wing Watch an AI enhanced interactive wildlife stream. BBC R&D.

3. NHK, AI를 이용한 점진적인 전진

NHK가 AI 활용으로 주목받기 시작한 계기는 2018년 3월, 뉴스 프로그램 《뉴스 체크 일레븐(News Check Eleven)》에서 헤드라인을 읽어주는 AI 아나운서 캐릭터 ‘요미코(ヨミ子)’를 선보이면서부터였다. 이후 NHK는 방송기술연구소를 중심으로, BBC의 파일럿 프로젝트와 유사하면서도 기존에 개발해 온 기술을 AI로 확장하는 다양한 프로젝트를 추진해 왔다.

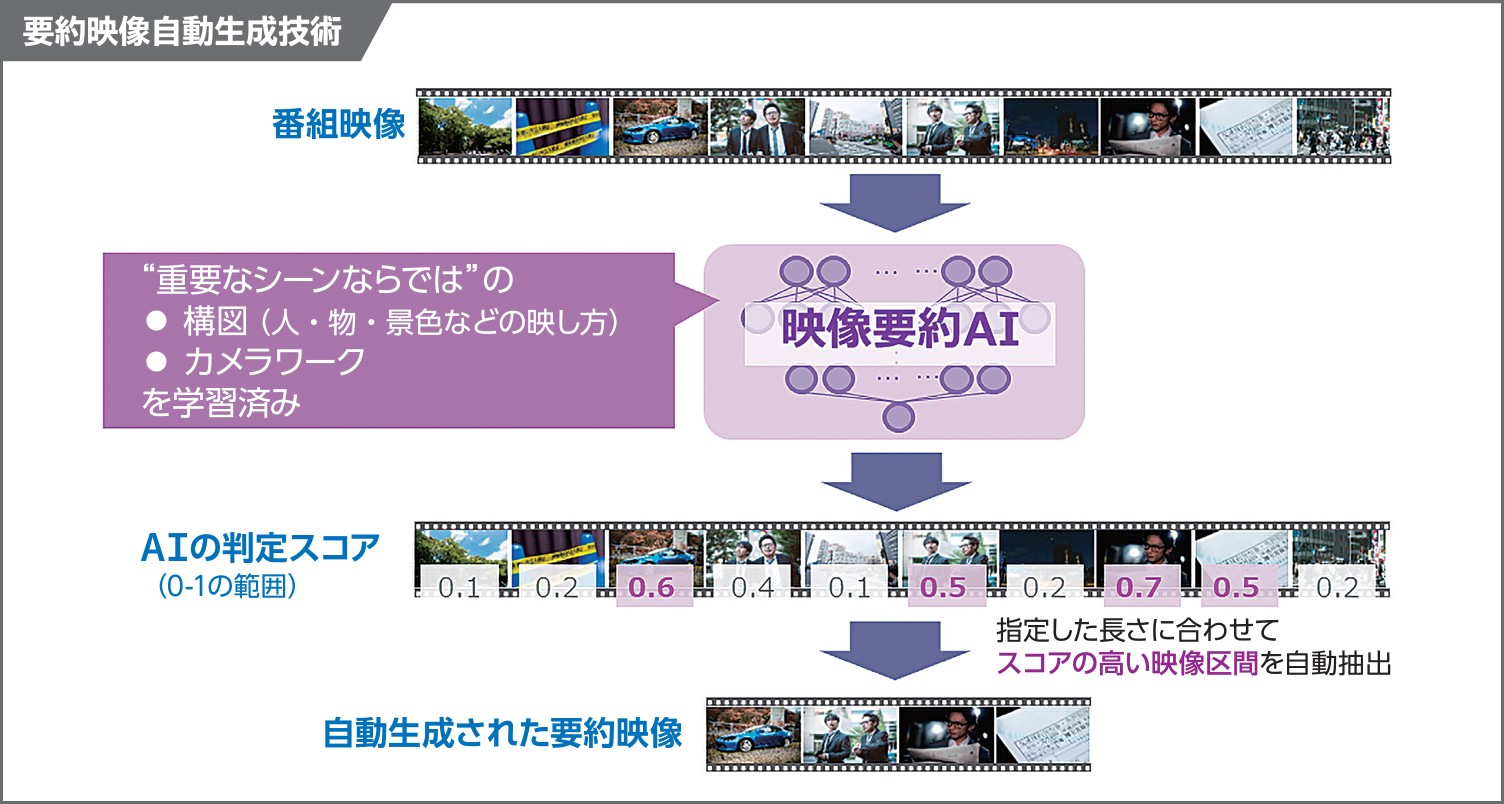

먼저 콘텐츠 가치 극대화를 위한 대표적 프로젝트로는 △AI 기반 요약 영상 자동 생성 기술 △흑백 영상의 컬러 자동화 시스템 △다국어 변환 등이 있다. 특히 AI 기반 요약 영상 자동 생성 기술은 뉴스 및 방송 프로그램의 웹용 숏 클립을 제작하거나 녹화된 영상의 내용을 신속하게 파악할 수 있는 요약 영상을 자동으로 생성하기 위해 개발되었다. 이 기술은 입력된 원본 영상에서 중요한 장면을 자동으로 식별해 짧은 요약 영상으로 편집하며, 별도의 스크립트나 메타데이터 없이도 영상만으로 작동한다.

작동 과정은 다음과 같다. 먼저 입력된 영상을 카메라 컷 전환 시점을 기준으로 분할하고, 이를 일정한 길이의 구간으로 나눈다. 이후 각 구간에서 구도, 인물, 카메라 움직임 등의 특징을 분석해 벡터 형태의 데이터로 변환한다. 마지막으로, 방송 전문가가 편집한 요약 영상을 학습한 AI 모델이 각 구간의 중요도를 점수화하고, 사전에 설정된 길이 내에서 점수가 높은 구간을 선별해 요약 영상으로 제공한다.

NHK는 2000년대 초반부터 실크로드와 같은 과거 방송 프로그램의 보관 영상을 정기적으로 보정해 왔으며, 2017년부터는 1960~70년대 제작된 16mm 필름 기반 방송 프로그램을 4K HDR로 변환해 방송에 활용했다. 특히 흑백 영상은 향수를 불러일으키지만, 컬러화는 당시 상황의 현실감을 높이고 시청자와의 정서적 거리를 좁힌다. 이러한 배경 속에서 NHK는 역사적 흑백 영상 콘텐츠를 딥러닝 기반 알고리즘으로 자동 컬러화하는 연구를 진행했다. 과거에는 수주에서 수개월이 소요되던 컬러 복원 작업이 AI 도입으로 크게 단축되면서 혁신적 접근으로 평가받고 있다. 이로써 희귀한 흑백 영상을 현대적으로 복원해 대중의 접근성을 강화하고, 역사 다큐멘터리 제작에도 신속히 활용할 수 있게 되었다.

한편, AI 기반 다국어 자막 서비스는 2024년 2월 12일 최종 중단되었다. NHK는 NHK 월드를 통해 웹사이트와 앱에서 24시간 영어 TV 방송을 제공해 왔으며, 다국어 자막 서비스는 2020년 4월 한국어, 중국어, 스페인어, 프랑스어 등 6개 언어로 시작했다. 2022년 3월에는 우크라이나어가 추가되어 9개 언어로 확대되었다. 이 서비스는 국제방송의 음성에서 생성된 영어 자막을 AI 번역으로 변환해 실시간으로 제공하는 방식으로, 구글 번역 API를 활용했다. 자막에는 “이것은 자동 번역입니다”, “번역이 완료되지 않았을 수 있습니다”라는 고지 문구도 함께 표시되었다.

그러나 2024년 2월 10일 오후 4시 뉴스에서 문제가 발생했다. 미·일 정상회담 관련 중국의 반응을 다룬 보도에서, 중국어 자막에 정치적으로 민감한 지명인 센카쿠 열도가 “오키나와현의 댜오위 열도” 및 “일본의 통제하에 있는 댜오위 열도”로 번역된 것이다. NHK는 이를 “NHK 서비스에 적합하지 않다”라고 판단해 같은 날 AI 자동 번역 기반 다국어 자막 서비스를 즉시 중단했고, 2월 12일 최종 종료를 발표하였다. 이 사례는 NHK 월드 서비스의 접근성과 도달 범위를 높이려는 시도가 자동 번역의 안정성과 정치적 중립성 문제에 의해 제약될 수 있음을 보여준다.

둘째, 새로운 시청자 경험 구축 사례로는 AI 가상 아나운서 <요미코>와 NHK 자회사 NHK 엔터프라이즈가 개발한 디지털 휴먼 기반 수화 아바타 <KIKI>를 들 수 있다.

<요미코>는 NHK 방송기술연구소(NHK-STRL)가 평창 동계올림픽 중계를 위해 개발한 AI 뉴스 읽기 시스템(TTS: Text to Speech)을 기반으로 제작되었다. 캐릭터 디자인은 인기 캐릭터 ‘컵의 후치코’의 창작자로 알려진 타나카 가츠키(田中 克樹)가 맡았다. 신경망 기반 TTS는 십만 단어 이상의 어휘를 학습해 자연스러운 음성을 구현했으며, 요미코는 2019년까지 특집 방송과 실험적 코너에 등장했다. 그러나 2020년 이후 프로젝트는 사실상 종료된 상태다.

<KIKI>는 AI 기술과 CG 애니메이션을 결합해 사람이 직접 수화를 하지 않아도 자연스럽고 정확한 수화 동작과 표정을 구현하는 아바타다. 방송, 온라인 동영상, 전시, 공공 서비스 등 다양한 환경에서 활용될 수 있도록 설계되었으며, 기존의 기계적 아바타와 달리 손동작·표정·시선이 자연스러워 실제 수화 통역사에 가까운 경험을 제공한다. NHK는 수화 전문가와 협력해 방대한 수화 단어·문장 데이터베이스를 구축했고, 이를 기반으로 AI가 손 모양과 움직임을 정확히 재현한다.

KIKI는 실제 수화 통역사의 초상권이나 개인정보 문제없이 대체 수화 표현을 제공할 수 있다는 장점이 있다. 이는 모든 방송과 웹 콘텐츠에 수화 통역사를 직접 투입하기 어려운 현실 속에서 청각장애인의 접근권을 보장하기 위한 시도로, AI와 공공성의 결합 사례라 할 수 있다. 특히 KIKI는 2025년 도쿄 청각장애인 올림픽(Deaflympics) 홍보대사 중 한 명으로 선정되기도 했다.

셋째, 업무의 신속성과 효율성 개선 분야에서는 △저널리스트 지원을 위한 대규모 언어모델(LLM) 개발 △아카이브 메타데이터 자동 생성을 꼽을 수 있다.

NHK는 그동안 뉴스 제작 지원을 위해 자동 원고 생성, 실시간 전사(transcription), 콘텐츠 분석 기술을 도입해 왔다. 자동 원고 생성 시스템은 강우·수위 데이터를 활용해 강 흐름 상태를 설명하는 원고 초안을 자동으로 작성하는 방식으로, 과거 뉴스 원고를 학습하여 지명과 수위 데이터를 결합해 문장을 생성한다. 실시간 전사 기술은 뉴스 진행자의 발언 등 방송 음성을 자동으로, 텍스트로 변환해 기사나 자막 작성에 활용된다. 콘텐츠 분석 시스템은 뉴스 요약, 주제·키워드 추출, 기사 내 데이터 분석 등을 지원하며, 소셜미디어 배포용 방송 콘텐츠 요약 영상 제작에도 사용되고 있다.

최근 NHK는 뉴스 제작 지원을 위해 방송사 내부 데이터를 학습한 대규모 언어모델(LLM) 개발에 박차를 가하고 있다. NHK 기술연구소는 2025년 5월 29일부터 6월 1일까지 열린 ‘기술연구공개 2025’에서 LLM 연구 성과를 발표했다.10) 연구소는 프로그램 제작 과정에서 다양한 업무 효율화를 목적으로 방송사 데이터를 활용한 LLM을 구축하고, 뉴스 보도 관련 질문에 대한 응답 정확성을 검증했다. 그 결과, 잘못된 응답 비율이 약 10% 감소한 것으로 나타났다. 이번 연구에는 약 40년간 축적된 뉴스 원고, 기사, 프로그램 자막 등 약 2,000만 문장을 학습 데이터로 활용했다. 이후 외부 기관이 실시한 뉴스 보도 검정 시험을 통해 학습 전후 오응답 비율을 비교·평가했다.

NHK 기술연구소는 이번 LLM이 응답 정확도를 개선했으나, 실질적인 제작 지원 도구로 활용되기 위해서는 추가 개선이 필요하다며 2026년 실용화를 목표로 연구를 이어가겠다고 밝혔다.

아카이브 메타데이터 자동 생성 프로젝트는 2024년 3월 EBU DTS 행사에서 소개되었다. 기존에는 프로그램명, 장르, 인물, 장소, 키워드 등을 사람이 직접 입력해야 했으나, 이는 시간과 비용 부담이 컸다. NHK는 2010년대 초반부터 시맨틱 인덱싱(semantic indexing)을 기반으로 텍스트와 비디오 특징을 추출하고 빅데이터 기술을 적용하는 방식으로 관련 연구를 시작했다. 현재는 다음과 같은 단계로 발전하고 있다.

1. 방송 음성을 인식해 자막·대본을 생성하는 자동 전사(ASR)

2. 생성된 텍스트에서 개체명(사람, 장소, 기관)과 주제어를 추출하는 NLP 분석

3. 장면 전환, 얼굴 인식, 물체 인식을 활용해 인물·사건을 태깅하고, 이를 멀티모달 방식으로 결합해 아카이브 DB에 반영

이 과정은 효율성과 속도 개선을 목표로 하나 아직 시험 단계에 있다. 자동 생성된 메타데이터의 정확성을 확보하기 위해 인간 검증(Human in the loop) 단계를 두고, 잘못된 태깅(false positives)이나 누락(false negatives)을 최소화하려 하고 있다. 또한 오태깅 발생 시 추적·교정이 가능하도록 사후 보정 구조를 도입했다. 아울러 메타데이터 필드의 명명 규칙(schema), 형식(format), 분류체계(taxonomy/vocabulary)를 EBU 및 국제 표준 기구와 조율하여, 자동 태그가 다른 시스템에서도 활용될 수 있도록 상호운용성을 고려하고 있다.

4. EBU, 회원사 AI 정보교류와 개발협력의 허브

유럽방송연맹(EBU: European Broadcasting Union)은 세계 최대 규모의 공영미디어 네트워크로, 유럽과 북아프리카 등 56개국 약 112개 공영미디어가 회원사로 가입해 있다. EBU는 전통적으로 △회원사 간 뉴스·콘텐츠 교류 △스포츠·이벤트 중계 △기술 연구와 표준화 △정책 가이드라인 정립을 주요 기능으로 수행해 왔다.

AI 분야에서 EBU는 △AI 윤리 △데이터 △자동 메타데이터 추출 △AI 벤치마킹 △추천 시스템 등 10개의 AI 관련 그룹을 운영하고 있으며, 정책·교육·실험·운영 단계에서 다양한 프로젝트를 추진하고 있다. 이 가운데 주요 사례를 간략히 소개하면 다음과 같다.

정책 측면에서 EBU는 EBU AI Summit, 생성형 AI 우선순위 전략 프로젝트, AI News Report 등을 통해 회원사들의 AI 역량 강화, 윤리적 문제 대응, 책임 있는 생성형 AI 사용 지침 마련, 뉴스룸에서의 생성형 AI 활용 현황과 전략 분석을 진행하고 있다.

실험·개발 단계 프로젝트로는 △차세대 메타데이터 표준 프레임워크 EBUCorePlus,11) △비디오 안면 인식을 위한 오픈소스 파이프라인,12) △스포츠 중계에서 클론 음성을 활용한 자동 해설·하이라이트 제작 프로젝트,13) △허위 정보(disinformation) 대응을 위한 검증 툴 <Vera.ai>14) 등을 들 수 있다.

운영 및 테스트 단계에 있는 프로젝트로는 △회원사가 공동 개발한 추천 시스템 <Peach>,15) △뉴스 콘텐츠 탐색과 응답을 제공하는 대화형 AI 에이전트 <Neo>,16) △전사와 번역 기술을 통합한 개방형 도구 <EuroVOX>17)가 있다.

특히 EBU는 2025년 6월 엔비디아(NVIDIA)와 ‘소버린 AI(Sovereign AI)’ 협력을 체결하여, 유럽 공영미디어들이 자체 데이터와 클라우드 인프라를 활용해 AI를 개발·운용할 수 있는 프레임워크를 마련했다. 이는 유럽 내 데이터 주권 확보와 표준화된 AI 파이프라인 구축을 목표로 하고 있다.

- 11) https://tech.ebu.ch/groups/mm

- 12) https://tech.ebu.ch/groups/ai-benchmarking

- 13) George Bevir (2023. 06. 20). Inside the EBU's AI voice cloning project at the European Athletics Team Championships. SVG NEWS

- 14) https://www.ai4europe.eu/ai-community/projects/veraai

- 15) https://docs.peach.ebu.io/

- 16) https://tech.ebu.ch/neo

- 17) https://www.eurovox.io/

5. 마치며

공영미디어 BBC와 NHK의 AI 활용은 △콘텐츠 가치 극대화, △시청자 경험 혁신, △업무 효율화라는 공통 목표를 지향하고 있다. 유럽 내 여러 공영미디어 조직들이 협력하는 네트워크인 EBU 역시 비슷한 방향에서 AI 협력을 추진하고 있다. 그러나 접근 방식에는 차이가 존재한다. BBC는 생성형 AI 파일럿 프로젝트를 통해 뉴스룸과 서비스 전반에 AI를 내재화하려고 시도하고 있으며, 최근 BBC 스튜디오가 설립한 AI 크리에이티브 랩을 통해 보다 혁신적인 실험을 적극적으로 전개하고 있다. 반면 NHK는 방송기술연구소를 중심으로 기존 연구개발 프로젝트에 AI를 점진적으로 적용하며 꾸준히 발전시키는 방식이 특징이다. EBU는 다국적 연합체로서 공동 표준화와 회원사 간 공동 개발을 견인하며 협력의 허브 역할을 하고 있다.

해외 공영미디어들의 사례는 국내 공영미디어에도 여러 시사점을 제공한다. 공영미디어는 AI가 시청자와 종사자에게 새로운 가치를 창출할 수 있다는 기대를 갖고 있지만, 동시에 AI가 모든 해답을 제공하지는 않으며, NHK의 다국어 자막 서비스 사례에서 보듯이 정치적·기술적 위험이 여전히 상존한다는 점도 분명하다. 특히 각 기관이 처한 환경에 따라 AI 활용 방식이 다르게 나타난다는 점에서 주목할 필요가 있다.

첫째, 시장경쟁 상황과 서비스 범위의 차이이다. BBC는 디지털 미디어 시장의 치열한 경쟁 압력 속에서 혁신 필요성을 더 크게 느끼고 있고, BBC 아이플레이어·BBC 사운드 등 다양한 플랫폼을 직접 운영하기 때문에 폭넓은 AI 파일럿을 추진할 수 있었다. 반면 NHK는 상대적으로 안정된 산업적 위치와 방송 기반의 플랫폼 운영에 주력하면서 AI를 업무 효율화 중심으로 활용하는 경향을 보였다.

둘째, AI 적용 방식이다. 해외 공영미디어들은 프로젝트를 단계적으로 전개하고 있다. 우선 적용 가능성을 탐색한 뒤, 절차와 방법을 점검하는 소규모 파일럿 프로젝트를 수행하고, 효과 검증을 위한 중규모 시범 사업(trial)을 거쳐 시청자가 이용할 수 있는 서비스로 확대하는 방식이다. 이 과정에서 해결하고자 하는 문제, 예상되는 위험 요인, 대응 방안, 평가지표 등을 명확히 설정한 뒤 다음 단계로의 확대 여부를 결정한다. 현재 다수의 공영미디어는 파일럿 수준에서 다양한 시도를 하고 있으며, 즉각적인 서비스 제공보다는 장기적으로 문제 해결에 기여할 수 있는 기반 기술을 시험·적용하는 데 초점을 맞추고 있다.

셋째, BBC 스튜디오의 실험적 시도이다. AI 크리에이티브 랩은 AI를 단순한 비용 절감 도구가 아니라, 공영미디어의 창의성과 공공성을 재구성하는 실험적 플랫폼으로 발전시키려 한다. 스토리텔링 전문성과 AI 기술을 결합해 새로운 미디어 형식을 개척하고, 윤리적 접근 방식을 통해 시청자 경험을 혁신함으로써 국제적 기준을 제시하고자 한다. 한국의 공영미디어 역시 AI를 단순한 기술 변화가 아니라, 새로운 미디어 형식과 스토리 창출을 위한 전략적 도구로 어떻게 활용할 것인지 고민해야 할 시점이다.